On 2025

올해는 회사 생활을 정리하고, 대학원에서 한 해를 보냈다.

2월

졸업

25.02.21.졸업식

휴학 기간이 길었지만, 결국 7년 간의 학교 생활이 끝났다.

고졸로 회사 생활을 시작해 대졸에 다 달으니 감회가 새롭다.

원래는 졸업식에 가지 않을 계획이었다.

퇴사 전 인수인계와 업무 정리로 바쁜 시기를 보내고 있었고,

친한 동기들은 이미 졸업하여 덩그러니 남은 졸업식에 기대감을 가지지 않았다.

그렇게 회사에 있다 졸업 프로젝트를 같이 한 동기의 연락을 받았다.

그래도 마지막인데 가서 사진이라도 하나 찍어야 하지 않겠냐 말이다.

부모님께는 안 가도 된다 이야기해 놓고,

막상 안 가려니 미련이 남아 오후 반차를 내고 졸업식에 갔다.

졸업식 분위기는 밝고 희망에 차 보였다.

이제는 더 오지 않을 학교에 괜한 아쉬움이 남기도 했다.

별 행사나 일정 없이, 동기와 사진 하나 찍고 집으로 돌아왔다.

돌아다니던 중 연락이 끊겨 이젠 어색해진 동기들과 인사도 했다.

많이들 가고 싶던 회사에 취업하여 밝은 표정을 하고 있었다.

괜히 부럽기도 했고, 나는 6년 동안 회사에 다니면서 무얼 해왔나 괜한 생각도 들었다.

졸업이라고 당장 달라지는 건 없었다.

내일도 출근할 것이고, 머지않아 퇴사 후 대학원으로 간다.

번듯한 대기업 직장인이 된 친구들을 보니 괜히 대학원이 더 초라해 보이기도 했다.

지금까지의 커리어는 괜찮았나 생각도 하고, 창업, 중소기업, 학업까지 해봤으니

다음은 대기업도 한 번 가보고 싶단 생각도 들었다.

정상성이라는 게 무섭다.

때맞춰 대학 가서 취업에 결혼까지,

나는 썩 정상적이진 않은 20대를 보내왔나 싶기도 했다.

괜한 비교를 뒤로하고 마지막으로 학교에서 내려왔다.

이사

독립한 후로 가능한 직장 30분 거리 내에서 집을 구하고 있다.

6시 퇴근 후 뭐라도 하려면, 이보다 더 멀어지고 싶진 않다.

벌써 세 번째 이사다.

이번엔 대학원 근처로 가려한다.

제시한 기준은 2층 이상 남향, 5평 이상이었다.

동네가 산에 붙어 있다 보니, 전반적으로 언덕이 많았다.

언덕이 많으니 건물이 남향이어도 앞 건물에 채광이 막혔다.

채광을 챙기고 나니 집이 오래됐거나 컨디션이 썩 좋지 않은 경우도 잦았다.

돌고 돌던 중, 낮 시간 채광이 만족스러운 집을 하나 찾았고

컨디션도 나빠 보이지 않아 바로 계약했다.

처음 집을 보았을 때는 꽤 넓어 보였는데,

입주를 하고 나니 직전 집보다는 작았다.

여름까지는 그럼에도 잘 지냈다.

문제는 겨울이었다.

입주 당시 도배가 새로 되어 있어 집주인이 친절하구나 싶었다.

알고 보니 외벽 단열이 거의 안 되어, 겨울의 시작과 함께 벽지에 곰팡이가 올라왔다.

꽤나 심해 나갈 때 되면 도배 다시 하겠구나 싶었다.

남향 채광을 찾다 보니 보통 방이 외벽에 붙어 있는데,

원룸 건물의 단열이 비슷한지, 지금까지 자취방에 벽지 곰팡이가 조금씩은 항상 있었다.

그럼에도 이번이 유독 심하기는 하다.

또 다른 문제는 언덕이다.

단순 힘든 게 문제가 아니었다.

새벽에 눈이 온 날, 언덕을 내려가는데 자꾸 쿵쿵 소리가 들렸다.

소리가 나는 곳에서는 사람이 한 명씩 넘어져 있었다.

눈이 녹다 얼어 언덕은 빙판이 되어 있었고,

나 또한 넘어짐을 피할 수 없었다.

문제는 집에서 내려가는 모든 언덕이 각도가 꽤 있어,

내려가는 것만이 문제가 아닌, 올라가는 것 또한 굉장히 아슬했다.

다음 자취방은 언덕도 완만하고, 단열도 잘 되는 남향집을 찾을 것이다.

돈 많이 벌어야겠다.

3월

입학

25.03.18.학교

연구실은 2월 중순부터 출근하였다.

퇴사 후 거진 바로 출근하게 되었다.

특이하게 올해는 3월에 눈이 왔는데, 학교에 쌓인 눈을 보며 감탄했다.

그와 별개로 학교 언덕도 눈이 녹다 얼어 아슬아슬한 출퇴근이 이어졌다.

그 외에는 나름 설레는 첫 한 달을 보낸 것 같다.

입학식은 따로 가지 않았고, 나중에 부모님과 정문에서 사진 정도만 찍었다.

부모님은 내가 대학원에 가길 바라셨는데,

학교 정문에서 좋아하시는 모습을 보니 나쁘지 않은 선택이었나 싶었다.

학교에 처음 와서 느낀 점은 두 가지였는데,

하나는 정말 학교가 넓다는 것이다.

집 앞 마을버스 종점에서 버스를 타고 학교에 가면,

회차지의 연구실까지 30분 정도 걸린다.

분명 학교에서 가장 가까운 전철역인데, 버스로 30분이라는 것이 첫 충격이었다.

두 번째는 첫 연구실 방문 당시였다.

연구실은 건축된 지 1년 채 안 된 신축 건물에 있었는데, 건물이 꽤 독특하게 생겼다.

정육면체 콘크리트 건물이 즐비하던 학부 때와는 또 달랐다.

그런 건물들은 일관되게 1층을 돌면 출입구가 나오는데,

여기는 문을 열고 들어가면 테라스가 나오고,

문을 열고 나가면 주차장이 나오는 알 수 없는 구조로 되어 있었다.

나는 첫날부터 건물에 들어가기 위해 30분을 내둘렀고,

건물에서 나올 때에도 30분간 길을 헤매었다.

첫 연구실 방문 후 교수님과 어떤 것들을 연구하고 싶은지 이야기를 나눴다.

30분 정도 일찍 출발하여 망정이지, 첫날부터 출입구 찾다 지각할 뻔했다.

연구실은 본래 3D 비전을 주제로 삼고 있었다.

그리고 근래에는 생성 모델과 로봇 연구로의 확장을 고려하던 상황이었다.

나는 생성 모델의 연구를 주제로 삼고자 하였고, 그리던 그림에 관하여 이야기드렸다.

먼저 물리적 요인을 잘 반영하지 못하던 기존 생성 모델의 문제점을 이야기드렸고,

이에 관한 개선을 첫 주제로 제안드렸다.

긍정적인 반응을 보이셨고, 문제점에 대해 더 구체화해 보기로 했다.

둘째는 생성 모델의 이론 파트를 연구하고 싶다 이야기드렸다.

대학원에 지원한 것은 돈이 안 되는 연구에 관한 갈증을 포함하고 있었다.

회사에서는 돈이 되는 연구를 수행하는데 초점을 맞추어 왔고,

그에 대한 피로도를 낮추는 시간을 가지고 싶었다.

당시는 Consistency Model에 관심을 가지고 있었고,

이에 대한 이론적 해석이나 수렴성을 개선하는 것도 괜찮을 것 같았다.

이 부분도 긍정적 반응을 보이셨고, 기존 연구의 재생산부터 시작해 보기로 했다.

교수님께서는 연구 주제에 열려 계셨고,

단체의 미션과 어울리는 연구 스토리라인을 만드는 것은 늘 해오던 일이었기에,

큰 무리 없이 원하던 주제에 관하여 설득할 수 있지 않았나 싶기도 하다.

25.04.10.학교

연구실 출근 후 맞닥뜨린 첫 어려움은 연구 보단 학교 생활이었다.

특히 수강신청에서 애를 많이 먹았다.

학부 때는 장바구니 같은 일정 없이 모든 과목이 선착순이었다.

여기는 시스템도 다르고 졸업 요건도 다르니, 수강신청 당일 뭘 들어야 하는지,

어떻게 신청해야 하는지 굉장히 얼타고 있었다.

그런 모습이 안쓰러워 보였는지, 선배들이 와 수강신청을 도와주었다.

뭘 들어야 하는지, 뭐가 좀 듣기 편한지, 어떻게 신청하는지 새로운 것투성이다.

다른 회사로 이직을 했어도 이렇게 새롭진 않았을 것 같았다.

첫 학기는 지적 허영을 채워도 되지 않을까 싶어, 재밌어 보이는 과목을 몇 집었다.

보안 회사에 다니면서 관심 있게 살피던 프로그램 분석 과목과

연구 주제와 관련된 확률 모델 과목을 신청했다.

과목 자체는 굉장히 흥미롭고 재밌는 주제를 다뤘다.

문제는 두 과목 모두 과제가 많기로 유명한 과목이었다.

선배들의 만류에는 이유가 있었다.

한 과목은 매주 강의 요약문 제출과 쪽지 시험,

6개의 과제와 기말 대체 팀 프로젝트까지

학교가 다른 대학원에 비해 코스웍 로드가 많다고는 들었지만, 예상을 넘은 분량이었다.

연구 주제 잡으랴 과제하랴 1학기는 어떻게 지나갔는지 기억도 잘 나지 않는다.

학부 때는 졸업 프로젝트를 제외하면 팀 프로젝트가 과제인 경우는 없었고,

몇몇 있던 것도 알고 지내던 동기와 함께하여 큰 무리가 없었다.

금번의 팀 프로젝트는 온전히 모르는 이를 모집하여 진행해야 했다.

다른 팀원의 모집 공고에 컨택하여 팀을 구성하고,

프로젝트를 진행함에 있어 모든 경험이 새로웠다.

특히 프로젝트 결과를 논문 형태의 글로 적어내야 했는데,

Grammarly와 GPT가 없었다면 정말 시간이 많이 들었겠구나 싶었다.

지금 시대에 대학원에 온 것이 다행인가 싶기도 했다.

다행히 흔히 말하는 빌런은 없어 무난히 마무리 지을 수 있었다.

4월

영어 공부

학교에 와서 처음으로 부담스러웠던 것은 주제 설정도 무엇도 아닌

세미나를 영어로 진행해야 한다는 것이었다.

연구실에서는 1주일에 한 번 한 사람이 원하는 주제로 세미나를 진행하는데,

신입생인 나는 5월에 첫 세미나가 배정되었다.

세미나는 발표부터 질의응답까지 모든 과정이 영어로 진행되었고,

이는 꽤 부담으로 느껴졌다.

생각해 보면 고등학생 때도 영어 공부를 그렇게 열심히 하진 않았던 것 같다.

크게 공부 시간을 많이 할애하지 않아도,

적당히 보고 적당히 찍으면 답을 맞히는 것에는 큰 무리가 없었다.

논문을 볼 때에도 단어군이 고만고만하니 읽고 이해하는데 큰 무리가 없던 것 같다.

문제는 인생에 영어로 대화한 경험은 손에 꼽는다는 것이다.

미국 본사와 협업하던 때에도 시차로 인해 통화 보단 메시지를 주로 남겼고,

구두로 대화할 일은 많지 않았다.

글을 쓸 때에는 GPT한테 검수라도 맡길 수 있었다.

말은 또 다른 문제 같았다.

바로 듣고 바로 말을 해야 할 것 같고,

모르는 말을 찾아보거나, 내 생각을 글로 적어보고 고칠 수도 없었다.

걱정만 하면 뭐 하나.

학원 갈 시간은 없겠다, 우선 영어 어플 두 개 1년권을 결제했다.

하나는 말해보카이고, 하나는 스픽이다.

생활 영어 단어에 문외한이란 생각이 들었고,

말하고 듣는 것도 해봐야 트인다고, 뒤 돌아보지 않고 긁어두었다.

둘 다 5월 발표에서 뭔가 큰 도움을 주진 않았다.

그냥저냥 원래 실력으로 어떻게든 넘어갔던 것 같다.

스픽은 그렇게 한 두어 달 하다가 어느샌가 안 하게 되었고,

말해보카는 출근길에 30분씩 거의 1년째 이어오고 있다.

말은 스픽 보다는 연구실의 프랑스인 친구와 이야기하면서 더 트인 것 같고,

생각보다 스픽에서 배운 어휘를 생활 중 쓸 만큼 내가 말이 많은 편은 아니구나 싶었다.

말해보카는 그래도 도움이 많이 되었다.

괜히 아침에 봤던 단어가 어느 날 미드 쇼츠에서 보이면 반갑기도 하다.

이건 값어치 했단 생각도 든다.

지금은 그래도 부담은 많이 줄어들었다.

한국어만큼 뉘앙스나 톤을 전달할 수준은 아니지만,

온몸 비틀기 하면 뭘 말하려 했는지 정도는 전달되지 않을까 싶다.

내가 못 알아들으면 상대방이 포기하거나 순화하겠지 싶은 뻔뻔함만 늘었다.

5월

통원

3월 이사를 오고 나니, 원래 다니던 병원에 다닐 시간이 애매해졌다.

왕복 2시간이 넘는 거리기에, 다녀오거나 시간에 맞춰 가기 어려웠다.

병원에서는 약 먹고 괜찮으면 안 와도 된다고 말했지만,

환경이 바뀌고 스트레스가 심해지니 증상이 재발했다.

우선은 근처 병원을 알아봤다.

문제는 근처의 거의 모든 병원이 지금 예약하면 한 달 뒤에야 방문이 가능하다는 것이다.

울며 겨자 먹기로 원래 다니던 곳을 계속 다니게 되었다.

다행히 첫 학기 연구실 생활 자체는 금방 적응해 나갔다.

1주일에 한 번 연구 보고에, 연구실 분위기도 첫 학기부터 학생을 밀어붙이지는 않았고,

해야 할 일도 연구 기반 조사와 코스웍 정도이니 크게 스트레스받을 일도 없었다.

스트레스가 줄고 나니 증상도 다시 완화되었고,

의사 선생님과 이야기 나눠 다시 약을 줄여나갔다.

완치가 없다지만, 괜찮다가도 이따금 그럴 때면 까마득하기만 하다.

적응이 된 것 같다가도 이게 참 쉽지 않다.

6월

부산 여행

25.06.13.부산

올해도 빠질 수 없는 부산 여행이다.

매번 가는 곳이 같다 보니 이젠 친구들이 사진만 봐도 얘 또 부산 갔네 한다.

이렇게 보니 사진도 매번 같은 구도인 것 같다.

올해도 특별한 건 없었다.

매번 가는 호텔에, 매번 가는 이자카야, 장어덮밥, 바닷가에서의 맥주가 다였다.

아쉬운 건 밤부터 이어진 비에 바닷가에서 산책은 못 하고 돌아왔다.

그래도 이렇게 한 번씩 가서 숨 돌리고 오는 게 좋다.

7월

조교

대학원을 졸업하려면 꼭 1회는 조교 활동을 해야 한다고 한다.

교수님께서는 80인 대형 강의를 하나 맡고 계셨는데,

여기에 3명의 학생이 조교로 참여해야 한다고 한다.

입학한 지 2주 차, 교수님께서는 본인 강의에 조교를 해줄 수 있을지 물어오셨다.

문제는 80명 강의에 졸업 요건으로 인정되는 조교는 최대 2인이었고,

먼저 졸업해야 하는 학생이 둘 있어, 나는 졸업 요건으로 인정되지는 않는다는 것이다.

대신 장학금이 있는데 도와줄 수 있을지 물어왔다.

좋은 게 좋은 거라고 하겠다고 했다.

이번에 한 번 해두면, 다음에 졸업 요건으로 인정되는 조교는 좀 편하게 하겠지 싶었다.

생각보다 조교 일이 적지 않았다.

수업 자료 제작 지원, 온라인 질의응답 게시판 대응,

과제 및 중간, 기말고사 출제, 채점 지원, 이의제기 대응,

최종 성적산출 지원 및 출결 처리까지

그래도 3명이니까 나눠하면 할만하겠지 싶었다.

중간고사까지는 괜찮았다.

함께하는 두 사람 모두 본인의 역할을 충분히 해주었다.

문제는 이후였다.

조교 한 명이 중간 이후로 연락이 되질 않았고, 학교에서 종적을 감추었다.

명확한 이유는 알 수 없었고,

증발하듯 사라진 그는 수학을 멈추고 고향으로 돌아갔단 이야기만 들려왔다.

80명을 조교 둘이 관리해야 했다.

교수님과 행정실에 연락하였다.

이런 상황이라면 졸업 요건 조교로 인정해 줄 수 있는지, 행정적으로 가능한지 물었다.

다행히 교수님과 행정실 모두에서 이를 참작해 주셨고,

나는 공식적으로 졸업 요건을 충족하게 되었다.

그럼에도 이 로드를 쳐내는 건 다른 문제였다.

코스웍도 있고, 개인 연구도 챙겨야 하는 상황에서, 조교 활동량도 늘었다.

어찌 시간이 흘러 학기가 마무리되었다.

80명의 시험지를 채점하는데 7~9시간 정도가 걸린다는 사실과,

학생들이 GPT를 과제에 적극 활용한다는 사실을 알게 되었다.

글씨를 알아보기 힘든 경우도 꽤 많았다.

답변이면 몰라도 학번 이름을 못 알아보면 이게 참 쉽지 않다.

나중에는 시험지 점수를 엑셀에 옮기고,

빈자리의 학생과 성명란을 대조하여 시험지의 주인을 찾기도 했다.

일처리가 괜찮았는지, 기업 특강 조교로도 몇 번 추천받아 활동하였다.

기업 특강의 경우, 코스에서의 성적이 인사 고과에 반영되기도 하다 보니,

과제나 시험, 성적에 더 민감해 보였다.

성적에 대해 더 적극적으로 컴플레인해 왔고, 다양한 형태로 사람을 곤란하게 했다.

그 외에는 잘 따라와 주시는 분들도 많았고, 실무 적용을 고민하시는 분들도 계셨다.

할 때는 힘들었는데, 현업의 이야기를 오랜만에 들으니 나쁘지만은 않았다.

과제

슬슬 나에게도 연구 과제 참여에 관한 이야기가 들려오기 시작했다.

재직 당시에도 기관 과제에 종종 참여해 왔다.

직접 관리를 하지는 않았었고, 주로 기술 개발이나 지원 업무에 가까웠다.

기획부터 결과 보고까지 관리한 것은 이번이 처음이다.

1년간 중간에 합류한 과제도 있고, 직접 제안서를 쓴 과제도 있다.

주로 내 연구 주제와 연계된 과제에 합류하게 되었다.

그래도 봐오던 게 있어서 그런지 새롭지는 않았다.

그럭저럭 연차 계획도 적고, 예산이나 장비 소요도 작성하였다.

운이 좋게도 작성한 과제 모두 선정되었다.

이후에는 개인 연구에 집중하고자 했다.

가능한 내 연구 주제에 맞춰 과제를 구성해 두기도 했고,

이제는 무언갈 더 들이기보다는 내 연구에 집중하려 했다.

그럼에도 어디선가 일이 계속 생겨

용무를 처리하다 보면 내 연구에 소홀해지기도 했다.

연구 주제 자체도 연구실 내에서 홀로 다루다 보니,

내가 소홀해지면 내 성과는 늦춰져만 갔고,

늦춰진 만큼 먼저 인용된 연구에 구식 취급을 받아갔다.

항상 신입은 첫 성과에 목마르다고,

논문 하나는 챙겨 졸업하고 싶어 더 여유를 놓쳐 갔던 것 같다.

서버 관리

연구실에서는 대부분 학생이 과제비 집행팀이나 서버 관리팀 중 하나로 활동한다.

나는 서버팀으로 배정되었고, 연구실의 GPU 서버 관리를 맡게 되었다.

학교 안에 비치된 서버실은 두 개가 있었는데,

생각보다 설비가 불안해 보였다.

하나는 강의실을 개조한 듯한 방에 서버를 설치해, 전력량이나 냉방이 아슬해 보였고,

하나는 온전한 서버실 건물이었지만, 정책상 연구실당 서버를 다수 비치할 수 없었다.

보통 서버에 문제가 생기면 앞선 서버실에서 문제가 발생하였고,

과열 장애, GPU 고장, 네트워크 대역폭 문제, 우천 시 패킷 로스 등 현상도 다양했다.

대개는 시간이 지나면 괜찮아지거나, 원격으로 해결할 수도 있었지만,

서버실에 방문해야만 하는 일도 적지 않았다.

부트로더가 깨져 OS 재설치도 하러 가고,

메인보드가 멈춰 강제 재시동도 하고,

고장 난 GPU 뽑으려도 갔다.

서버실도 학내 버스를 타고 가야 하다 보니,

한 번 다녀오면 넉넉히 3시간은 잡아야 한다.

여기에 서버 접근 권한 관리를 포함하면,

하루는 서버 관리만 하다 지나가기도 한다.

8월 25.08.04.KCCV

KCCV

올해는 국내 학회에 다녀온다.

개발자 컨퍼런스만 가봤기에 연구자 학회는 좀 다를까 했지만, 크게 다르지는 않았다.

비슷하게 CFP를 내 포스터나 구두 발표도 하고, 부스 운영도 하는 익숙한 모습이었다.

가서 요즘은 어떤 연구를 많이 하나 구경도 하고,

새로 보는 사람들과 인사도 나누며 지냈다.

학회 자체와는 무관히, 2박 3일 연구실 사람들과 같이 있으며 친해져 오기도 했다.

이전까지는 직장 동료의 선에서 이야기를 많이 나눴다.

이야기도 일이나 연구에 관한 것들 위주이고 사적인 이야기를 나누지는 않아 왔다.

회사에서는 보통 내가 막내였고, 바로 위 선임이 최소 두세 살은 차이가 났다.

직책도 있다 보니, 남들을 편하게 대하기 어려웠다.

연구실 첫 학기도 그런 스탠스로 지내왔다.

지나고 보니 꼭 그럴 필요는 없던 것 같다.

여기서 나는 딱 중간 정도 나이였고, 사람들도 서로서로 친해 보였다.

학회를 기회로 연구실 사람들과 말도 놓고, 시시콜콜한 이야기도 나누게 되었다.

AIxCC

25.08.AIxCC Final, 3rd Place.

23년 재직 당시에는 LLM을 활용한 취약점 탐색 자동화를 시도하고 있었다.

특히 나는 코드가 존재하는 상황에서의 탐색에 초점을 맞춰 왔다.

24년 미국 DARPA에서 AIxCC라는 AI로만 운영되는 해킹 대회를 열겠다 발표한다.

소프트웨어 빌드부터 취약점 후보군 발굴, PoC 입력 생성 및 테스트,

Sanitizer 트리거 및 패치를 전자동화하는 대회이다.

대회가 시작되면 사람 없이 온전히 AI가 대회 서버로부터 문제를 받아 취약점을 찾는다.

해당 대회에 관심을 가지고 초기부터 참여에 관한 의견을 피력했다.

특히나 졸업 프로젝트로 LLM 기반 Fuzzing Harness 생성을 연구해 왔기에,

23년 프로젝트와 졸업 프로젝트의 연장선상으로 참여해도 좋을 듯했다.

하지만 대회의 규모에 비해 규정의 구체성은 빈약했고 시기에 따라 계속해서 변했다.

AI팀의 한 파트를 온전히 투입하기에는 대회의 향방이 불분명하여,

예선은 최소 인원만 참여하기로 하였다.

당시 나는 새 프로젝트로 여력이 없어 예선에는 불참하게 되었다.

이후 24년 말 매니저에서 개인 기여자로 직무를 변경하고,

새 프로젝트도 다음 매니저에게 인수인계하였다.

예선에 나갔던 팀은 1위로 예선을 마무리했고,

나는 자연스레 본선에 합류하게 되었다.

취약점 발굴 시스템은 크게 두 파트로 구성되었다.

시스템을 빌드하고 Fuzzer를 돌리는 파트와

LLM을 통해 취약점 후보군을 찾고 시드를 생성하는 파트이다.

전자는 예선에서 사용하던 시스템을 리팩터링 하여 사용하기로 하였고,

예선팀은 이에 더불어 본선 규정에 맞게 시스템을 업데이트하는 것에 초점을 맞췄다.

후자는 AI팀에서 추가 투입한 인원을 위주로 개선 작업에 들어갔다.

24년 말 대학원 입학과 함께 퇴사의 의사를 밝혔다.

가능하다면 대회의 마무리를 보고 가고 싶다는 의견이 긍정적으로 받아들여져,

8월의 본선까지는 남는 시간을 활용하여 대회 참여를 함께하게 되었다.

23년의 프로젝트 당시에는 GPT3.5를 위주로 사용하던 시기였고,

Tool Call API와 LLM Agent의 개념이 활발하지 않았기에

대부분을 CoT 기반 프롬프팅으로 해결하고 있었다.

이 경우 소스 코드에 따라 프롬프트가 길어지면 성능 하락이 가시적이었고,

완화를 위해 계층에 따라 정보를 추상화하여 취약점 후보군을 각각 작성하도록 하였다.

실제 CVE로 발견된 취약점의 위협 시나리오를 작성하는 것에는 성공하였으나,

작성되는 후보군 중 위양성의 비율이 높아 실제 취약점으로 직역하기에는 한계가 있었다.

이후 위협의 실증 시스템을 만드는 걸 24년 목표로 잡았었고,

운이 좋게 AIxCC에 관심이 모이며, 실증 시스템에 AIxCC 구현체를 활용하기로 하였다.

아쉽게도 퇴사가 겹치며 실증 시스템으로의 확장은 보지 못하고 마무리 짓게 되었다.

25년이 되며 이전과는 상황이 달라졌다.

24년 GPT4 이후 Tool Call API가 공식 지원되기 시작했고,

CoT 프롬프팅을 넘어 Tool Call을 통해 필요한 정보만 전달하는 것이 가능해졌다.

프롬프트 길이는 줄어들었고, 성능 하락도 개선되었다.

23년 당시 기술을 직접 활용하지는 않았다.

예선은 특히나 주어진 Git 레포의 커밋에서만 취약점이 발생한다는 규정이 있어

코드를 전수 조사할 필요 없이, 커밋 Diff를 읽는 것만으로 위협 후보 발굴이 가능했다.

본선에는 전체 코드 베이스를 스캔하는 트랙이 신설되었으나,

Tool Call이 가능해진 시점에서 굳이 과거 스택을 쓸 이유가 없었다.

미국 팀은 예선서 Tool Call을 기반으로 위협 후보를 발굴하는 시스템을 재개발하였고,

본선에 합류한 나는 이후 시드 생산과 Fuzz Blocker 대응 파트를 담당했다.

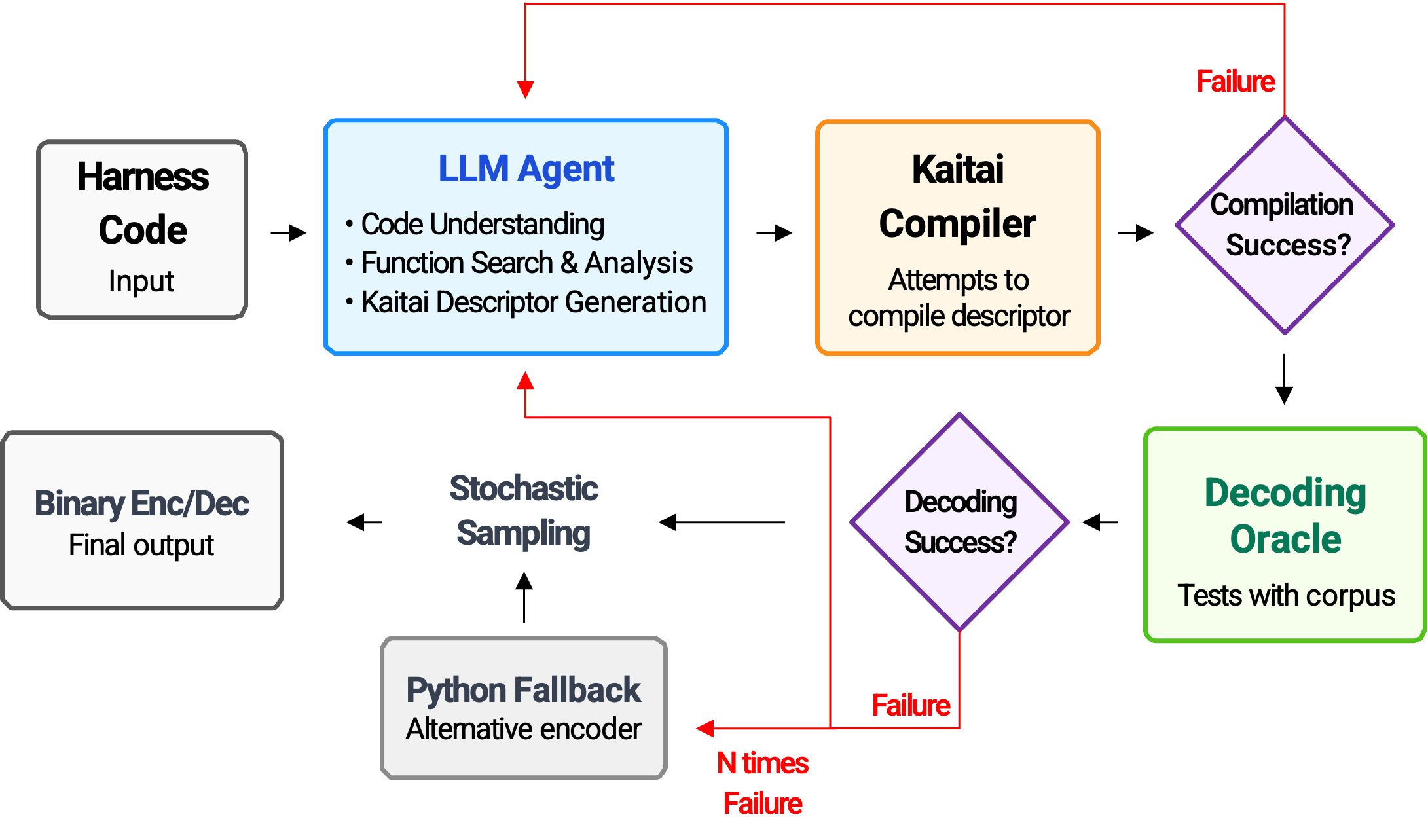

Binary Encoder-Decoder

25.08.AIxCC, Kaitai struct workflow

LLM은 Binary Blob 보다는 자연어 출력에 초점을 맞추고 있었고,

어떻게 Binary Blob을 만들 것인가는 여전히 고민해야 할 문제였다.

예선에서는 LLM에게 하네스를 읽고 입력 스트림을 생산하는 스크립트 작성을 지시했다.

의도는 여러 시맨틱 입력을 받아 Blob으로 인코딩하는 파이썬 스크립트를 생산하고,

이를 기반으로 Blob 입력을 양산, 테스팅을 통해 인코더를 개선하는 루프를 예상했다.

실제로는 하네스가 복잡한 경우 테스팅 단계에서 인코더의 Sanity check에 실패하고,

LLM은 우선 유효성 검사를 통과하기 위해 인코더를 단순화해 나갔다.

그럼에도 해소가 되지 않으면, 말미엔 단순 Identity 함수를 출력하곤 했다.

이름, 이메일과 같은 시멘틱을 입력으로 받아 바이트 스트림을 생산하는 것이 아닌,

Blob을 입력으로 받아 그대로 출력하며 인코더라고 주장하는 것이다.

미국팀과의 논의에서 바닐라 파이썬 스크립트보다는

External Binary Descriptor를 쓰는 것이 어떤지 이야기 나눴고,

내 첫 기여는 하네스가 주어졌을 때 입력을 명세하는 Descriptor을 생산하는 것이었다.

여러 Descriptor format 후보 중 우리는 Kaitai struct를 활용하였고,

이 현상은 Kaitai struct의 형태로 인코더를 형식화한 후에 다소 완화되었다.

자유도가 낮아지는 대신 입력 형태를 타입-길이-메타데이터로 정형화하다 보니,

LLM은 복잡한 하네스에서도 기존보다 더 설명론적 출력을 내려는 경향성을 보였다.

대신 신택스 에러에 의해 Kaitai compiler를 통과하지 못하는 문제가 발생하였다.

여러 시도를 통해 Kaitai struct와 파이썬 스크립트를 함께 사용하기로 하였고,

Blob 생산 단계에서 Kaitai와 파이썬 스크립트를 사용한 분기 각각을 시행하게 하였다.

실제로 이러한 다중화 전략이 상호 보완적 Fallback의 형태로 작동하여,

취약점 발굴 성능 개선으로 이어질 수 있음을 보였고, 시스템에 최종 머지되었다.

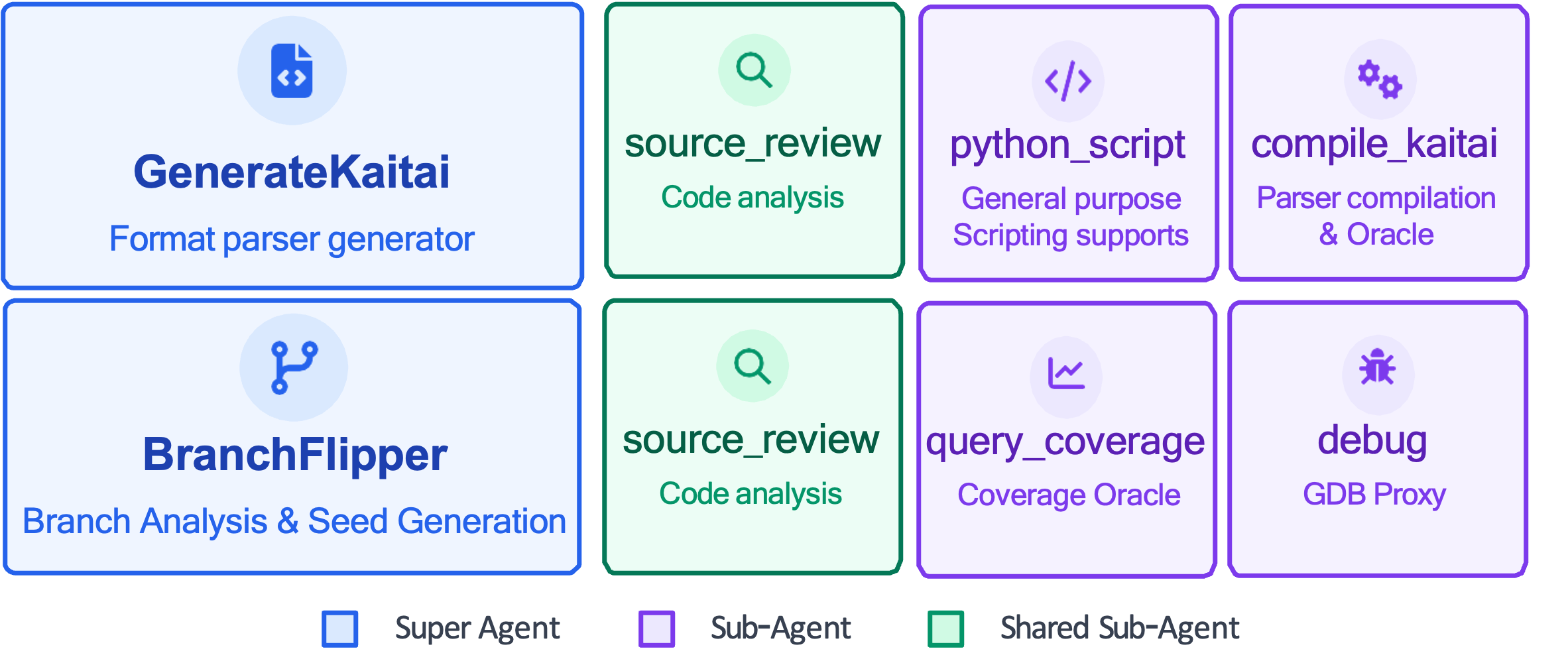

Branch Flipper

25.08.AIxCC, 담당 파트

예선 당시에는 취약점 후보로 타겟 파일과 라인을 명시한 후

하네스를 타겟팅하여 Blob Encoder를 생산,

다음 에이전트가 이를 활용하여 타겟 라인에 접근 가능한 입력을 찾아갔다.

다만, 베이스라인 시드가 없는 상태에서는 유의미한 입력을 생산하는 데 한계가 있었고,

타겟 라인 근방에 도달하는 기저 시드를 제공할 필요가 있었다.

이를 위해 시스템은 병렬적으로 백그라운드에 퍼저를 돌려 시드를 수집해 두었다가,

요청이 오면 가장 인접한 라인까지 접근한 시드를 찾아 회신하도록 했다.

가능한 많은 함수에 미리 접근해 볼 수 있다면

에이전트가 별도의 시드를 만들지 않아도 타겟 라인에 접근이 가능해지거나

그런 시드를 만드는 비용을 줄일 수 있을 것이다.

내 다음 목표는 시스템에서 Fuzz blocker의 alert가 발생하면,

콜백을 두어 해당 Blocker branch를 flip 할 입력을 생산하는 것이었다.

Blocker가 해소되고 나면 부가적인 코드 커버리지를 획득할 수 있고

이에 연계된 function call을 통해 더 많은 함수의 사전 탐색을 가능케 하는 것이다.

LLM Agent를 하나 두어 해당 브랜치까지 접근한 시드, 목표하는 라인을 주고,

원하는 분기 도달을 위한 Predicate 분석, 시드 생성, 테스트에 관한 툴을 제공한다.

LLM은 Tool을 통해 주어진 시드 위에서 분기에 도달하기 위한 뮤테이션을 시도한다.

테스트 툴에서 도달 신호가 발생하면 LLM은 뮤테이션을 종료하고 결과를 반환한다.

간혹 LLM이 목표 라인에 도달하지 못했음에도 성공으로 마킹하고 종료하는 사례가 있어

접근 여부를 fuzz profile에서 확인하는 등의 그라운딩 프로세스를 추가하기도 했다.

이러한 프로세스를 설치한 것까지는 괜찮았으나,

예상보다 시스템에서 alert 하는 Blocker의 수가 상당히 많았고,

이에 대해 에이전트를 게속 호출하면 비용을 감당할 수 없었다.

시스템 팀과의 논의와 분석을 통해

하네스에 하드 코딩되어 물리적으로 접근 불가능한 False alert의 존재를 확인하였고,

불필요한 자원 낭비를 줄이고자 Blocker에 대한 Triage 프로세스를 추가하였다.

이후 Flipper는 예산 내에서 작동할 수 있게 되었고, 마찬가지로 시스템에 머지되었다.

최종 대회는 3등으로 종료되었다.

비록 대회 현장에 직접 방문하지는 않았지만, 소식을 들었을 때는 굉장히 기뻤다.

예선을 고려하였을 때 아쉬움이 없던 것은 아니었으나,

할 수 있는 선에서는 최선을 다해 후회는 없던 것 같다.

이렇게 정말 회사와의 관계가 마무리되었다.

23년에 해킹 AI를 만들겠다는 포부를 보였던 게 오래지 않은 것 같다.

자의와 타의에 관계없이, 당시의 목표가 시대의 흐름에 맞게 내재화되었단 점에서

또 다른 안도감을 느꼈다.

퇴사 당시 내가 회사에 무엇을 남겼는지, 어떤 긍정적 기여를 하였는지 고민이 많았다.

오히려 대학원이 도피에 가까웠나 싶기도 했다.

그럼에도 팀의 연구 문화, 목표 관리, 문서화 등 기여를 인정받았고,

AI의 기술적 내재화에 기여하며 마무리 지었단 점에서 아쉬움만 남지는 않은 기간이었다.

아마 다음 회사에 간다면, 비전을 보이고 기여하는 것에 넘어

비전 자체를 온전히 구현해 낼 수 있는 사람이 되고 싶기도 하다.

9월

ICLR2026

3월의 면담 이후 나는 학부생 인턴 3인과 함께 1년 정도 연구를 수행해 왔다.

두 가지 프로젝트를 구상하였고,

하나는 생성 모델이 Physical property에 약하다는 지점에서 시작하였다.

GPT 생성 이미지; 진공관 속 양초

진공관 속에 양초가 있다고 가정하자.

산소가 없는 공간이기에 양초는 발화하지 않을 것이라 예상할 수 있다.

하지만, 여전히 GPT나 오픈소스 이미지 생성 모델은 불이 켜진 양초를 그리곤 한다.

GPT는 해당 이미지가 어색하다는 점을 모를까.

GPT에게 물리적으로 어색한 요소를 꼽으라 하면 불이 켜질 수 없다는 점을 잘 짚는다.

이를 반영하여 다시 그리라 요청해도 GPT는 여전히 불이 켜진 양초를 그린다.

이러한 인지와 생성 사이의 간극이 어디서 발생하는지, 어떻게 해소할지 고민하였다.

몇 가지 가설이 있었다.

이미지 생성 모델은 학습 중에 진공관 속 양초를 관찰했을 가능성이 적다.

모델은 진공관이라는 개체와 양초라는 개체를 처음 합성해 보았을 것이다.

네트워크의 캐퍼시티가 무한하지 않는 이상,

모델은 둘의 물리적 관계성을 충분히 고려하지 않고 단순히 둘을 한 곳에 놓았을 수 있다.

순차 연산이 없는 마르코프 프로세스의 디퓨전 모델은 표현력에 제약을 갖기에

학습 중 관측된 적 없는 개체의 합성에 물리적 요인을 고려할 여유가 없었을 것이다.

이 간극을 줄이기 위해서는 관계성 추론을 마친 조건 정보가 외부에서 제공되거나,

인지와 마찬가지로 생성에서도 관계성을 추론할 여유를 순차 연산을 통해 부여해야 한다.

순차 연산을 포함한 생성 모델을 조사하였다.

대부분 인지와 생성이 합쳐진 Any-to-Any Generation의 형태였지만

아직 연구 단계의 성능으로, 물리적 관계성 외에도 전반적 성능이 예상을 넘지 못하였고,

특별히 물리적 관계성만 관찰하는 것이 무의미했다.

인지가 물리적 직관에 더 정렬되어 있다는 점에 착안하여

외부 모델을 통해 관계성을 추론하여, 생성 조건으로 강제하는 형태도 고려하였다.

다양한 배경조사와 실험이 이루어지던 중,

몇 가지 고민이 생기기 시작했다.

OpenAI는 4월 DALL-E를 벗어나 GPT4o 이미지 생성 API를 새로 발표한다.

기존처럼 인지-생성이 분리된 형태가 아닌 공유된 모델 파라미터가 존재하는 듯했고,

그 과정에서 더 많은 데이터가 병렬적으로 학습된 듯 보였다.

GPT가 보여 온 인지 성능 위에 SOTA 수준의 생성 성능을 함께 선보였다.

GPT4o에서는 우리가 실패 사례로 수집하던 케이스 중 적지 않은 사례가 해결되었다.

Any-to-Any 인터페이스로 공개된 만큼,

순차 연산을 포함한 생성이 관계성 해석에 영향을 미쳤을 수도 있겠다.

데이터 스케일링을 통해 엣지 케이스 중 다수가 이미 관측되어 그럴 수도 있겠다.

이러한 인지적 차이를 꼭 물리 세계의 반영 여부에 제약하지 않더라도,

꽤나 많은 인지-생성의 간극이 데이터 스케일링으로 해결될 수 있을 듯 보였다.

만약 우리가 순차 연산 자체를 태클한다면,

인지-생성의 간극보다는 디퓨전의 표현력 문제로 접근하는 것이 나아 보였다.

관계성 그래프를 통해 이미지 생성을 시도하거나,

LLM을 통해 생성에 Guidance를 부여하는 방법도 동년도 NeurIPS에서 공개되었다.

방법론상으로 더 이상 차별점이 있다 여기기 어려웠고,

연구실 규모에서 데이터 스케일링을 시도하는 것도 쉽지 않다.

문제가 온전히 풀렸다 볼 수 있는 정도는 아니었지만,

이 정도 모멘텀이라면 내가 들어가 볼 만한 필드로 느껴지진 않았다.

그렇게 6월, 프로젝트는 잠시 접어두기로 하였다.

연구 참여생은 대신 당시 논문화를 준비하던 두 번째 프로젝트를 도와주게 되었다.

Consistency Models

두 번째 주제는 Consistency Model의 수렴성에 관한 논의이다.

시작부터 인턴과 함께하던 주제는 아니었고,

순전히 개인적 흥미에 따라 연구하던 주제였다.

24년 당시 대학원 입학을 위해 교수님께 컨택 메일을 넣었었고,

주어진 논문에 대해서 기술 면접을 보고 결정하자는 회신을 받았다.

그렇게 요청받은 논문이 Consistency Model (CM)이었다.

면담은 무난하였고, 최종 연구실에 합류하게 되었다.

이후 자연스레 개인 연구 주제로도 고민을 하게 되었다.

당시에는 Yang Song의 sCM이 SOTA 모델이었고,

본격적인 연구 주제 설정에 앞서 해당 모델을 재생산해보기로 하였다.

공식적으로 공개된 오픈소스 프로젝트는 없었고,

비공식적으로 연구 개발 중인 사례는 있었으나 성능상 재생산에는 실패한 듯보였다.

나 또한 2-3개월간 재생산에 시도하였으나 유사한 수준의 성능을 만들지는 못하였다.

다른 CM 계열 모델의 재생산도 시도하였으나,

디퓨전과 비교하였을 때에는 재생산이 어려운 편에 속하였다.

4월이 지나 문득 재현 난도 자체가 CM의 속성이라 여겨야 하는지 고민하게 되었다.

그렇게 CM의 수렴성과 재현성에 관하여 배경 연구를 더 조사하던 중,

24년 말미부터 25년 초에 유사한 질문을 하는 연구들을 찾게 된다.

CM이 궁극적으로 수렴하는 모델이 어떤 방정식을 따르길 바라는지,

그에 대비하였을 때 현행 학습 방식은 어떠한 괴리를 가지는지 고찰을 하던 시기였다.

사전 연구의 증명을 따라 써보고, 실제 구현도 해보며 시간을 가지던 중

논증이 대개 괴리를 없애기보다는 줄이겠다의 어조에 가깝다는 점과

이를 위해 별개의 네트워크를 가정한다는 점에서 아쉬움을 느꼈다.

그렇게 5월경 본격적으로 전역해로의 수렴을 연구 주제로 잡게 된다.

괴리 혹은 격차를 0으로 만들면서도 추가 자원 없이 학습 가능한 방법론을 목표로 했다.

주제가 재현의 실패에서 시작한 만큼,

더 안정화된 학습 방법론을 제공한다를 넘어 재현성을 높인다는 점을 시사하고 싶었다.

스토리라인은

(1) 근래의 CM 연구를 관통하는 하나의 방정식을 제안,

(2) 해당 방정식을 통해 기성의 학습 방법론을 재해석,

(3) 이 방법론들이 목표 방정식으로의 전역 수렴을 보장하지 않는다는 점과

(4) 보장을 위한 필요조건, 그에 따라 새로운 학습 방법론을 제안,

(5) 벤치마크 성능은 유지되면서도 재현성은 개선됨을 보이고 싶었다.

앞선 4개는 실험 없이 증명만으로 보일 수 있는 영역이었고,

사전 연구의 세팅과 증명 흐름을 확장하는 방식으로 논증을 정리해 두었다.

기존의 CM 연구에 파편화되어 있었던 세팅을 하나의 표현식으로 재구성하고,

해당 식에 맞춰 CM이 만족해야 하는 방정식을 확장했다.

자연스레 기존의 연구는 확장된 식의 인스턴스로 표현될 수 있었고,

사전 연구서 밝혔던 괴리를 확장된 식의 Functional gradient를 기반으로 재해석했다.

그러고 나니 괴리의 원인이 Guiding velocity에 있음이 명확해졌고,

CM의 limit property를 활용하여 괴리를 0으로 만드는 것이 가능함을 확인하였다.

자신의 property를 통해 자신을 guiding 한다는 의미로 Self-distillation이라 하였고,

본격적인 벤치마크 실험에 착수했다.

교수님께 해당 연구의 논문화를 제안드렸고,

7월 당시 9월 ICLR 2026를 목표로 하는 계획을 세우게 된다.

이 시점부터 인턴들도 프로젝트에 합류하여 논문화를 도와주게 된다.

최적의 세팅을 찾기 위한 Ablation study가 시작되었고,

인턴들과 함께 하이퍼파라미터나 세팅을 조율해 가며 범위를 좁혀 나갔다.

실제로 작은 모델에서 사전 연구의 Ablation study 보다 좋은 결과를 보였고

이대로 큰 모델의 성능만 잘 나오면 글을 제외한 스토리라인은 고지를 내보고 있었다.

큰 모델은 대략 1-2주간 학습이 필요했고,

8월 첫 결과서 우리 방법론은 스케일링에 한계가 있음을 확인하였다.

작은 모델에서는 성능도 약소하게나마 개선되고, 재현성도 큰 폭 나아졌지만,

모델이 커지고 나니 성능이 기성 연구들에 비해 처참히 낮은 것이다.

이때부터 골치가 아프기 시작했다.

그뿐 아니라, NeurIPS 2025에 제출되었던 논문 중

우리와 같은 방식으로 학습을 수행하며, 이름도 Self-distillation인 연구가 공개되었다.

당황스러웠다.

차이점은 해당 연구의 동기와 수식적 전개가 우리와 다르다는 것,

CM 세팅에서의 Self-distillation이 학습 불안정성을 겪는다는 한계를 명시한 점이다.

논문이 한 달 남은 시점,

우리는 기성 방법론을 포괄하는 세팅에서 더 나은 인스턴스를 선택하는 과정을 보인 점,

그렇기에 CM 세팅에서의 Self-distillation 학습을 안정화할 수 있었던 점,

더 큰 모델로의 스케일링을 시도했다는 점에서 차별점을 가져가기로 했다.

그럼에도 같은 방법론의 등장은 우리의 노벨티가 희석되진 않을까 불안을 일기 충분했다.

우린 논문 제목도 Self-distillation에서 improved Self-distillation으로 바꾸고,

글도 대폭수정해야 했다.

연구가 활발하다는 것은 언제든 선점당할 수 있다는 의미임을 새삼 다시 느꼈다.

네트워크 스케일링의 실패는 우리의 한계점으로 정리해야만 했다.

시간이 얼마 남지 않은 시점, 세팅을 바꿔 시도할 수 있는 실험은 최대 3회였다.

우선 글은 보수적으로 작성하되, 최대한 가능성 높은 세팅을 선별하여 실험을 수행했다.

하지만 마지막 9월 제출까지도 성능은 SOTA 근방에 다가가지 못했다.

이렇게 학회 제출을 목적으로 글을 써보는 것은 처음이었다.

그리고 내가 글을 상당히 공격적으로 작성하는 편이란 걸 느꼈다.

글의 전반적인 틀이 정리된 후에는 연구 참여자들과 분배하여 글을 작성하였다.

이후 교수님께서 주신 피드백은 내 글이 전반적으로 공격적이라는 것이었다.

다른 연구는 이걸 못한다의 직접적인 비교나 어조는 피하는 것이 좋다고 했다.

재직 당시에는 경쟁사 분석에서 이런 직접적 비교를 많이 요구받아왔던 것 같다.

우리가 어떤 가치를 더 제공할 수 있는지,

왜 우리 제품을 써야 하는지를 더 쉽고 빠르게 고객들에게 각인시켜야 했다.

피드백 분위기는 사뭇 달랐다.

기본적으로 다른 연구에 대한 존중이 뒷받침되어야 하고,

직접적 비교보단 충분한 존중을 보이며 우리의 가치를 보완적으로 가져가야 하는 듯했다.

글을 작성하면서 기존 습관을 의도적으로 배제하는 것이 가장 큰 어려움이었다.

어느 순간 보면 문장은 다시 원래의 습관대로 돌아와 있었고,

이를 다시 수정하고 덜 공격적으로 보이게 쓰는 과정의 피로도가 상당했다.

그 외에도 단어 선별, Related Work에 들어가야 할 내용 등 고쳐야 할 부분이 많았고,

괜스레 처음이란 게 쉽지 않구나 싶었다.

그래도 미리 준비했던 만큼 여유 있게 최종 버전을 마무리 지었고,

학회에 정상제출되었다.

인턴 학생들도 본인이 맡은 실험, 글, 후속 검수에 최선을 다해주었고,

정말 혼자 했다면 까마득했을 일을 잘 마무리할 수 있었던 것 같다.

그래도 사람 복은 있나 보다.

10월 25.10.17.오사카

오사카 여행

ICLR 준비로 5월부터 한 번 쉬지 못하고 달려왔다.

학회 제출 후 연차를 쓰고 여행을 다녀왔다.

보통은 국내로 많이 다녔는데,

이번엔 비행기 값이 비싼 기간을 피해 가까운 오사카에 다녀왔다.

오사카는 관광지라 그런지 기본적으로 영어는 다 통했다.

작년 삿포로 때만 해도 영어가 잘 통하지 않아

일본어 읽을 줄 아는 친구, 말할 줄 아는 친구가 어떻게든 소통을 하려고 애썼었다.

영어가 통한다는 게 이렇게 편할 줄 몰랐다.

이번 여행은 대체로 맛있는 거 많이 먹고, 많이 돌아다니자는 편이었다.

미리 예약이 가능한 맛집들은 시간에 맞춰 예약해 두고,

그 사이사이 나라에 사슴도 보고 오고, 길거리 산책도 하고 이것저것 많이 해본 것 같다.

가장 기억에 남는 건 로바타 키타로 스시이다.

로바타야키라는 화롯불에 천천히 익힌 생선 구이를 파는 곳이다.

여기서는 버리는 소금이 반이 넘을 정도로 생선에 소금을 던지듯 뿌려서 구워주는데,

찾아보니 간을 균일하게 맞추기 위한 과정이라고 한다.

퍼포먼스인가 싶다가도, 먹고 나면 이렇게 촉촉하고 간이 잘된 구이가 있을까 싶다.

그 외에도 사슴은 생각보다 털이 뻣뻣하고 부드럽지 않다는 것도 알게 되고

육수를 넣어 만든 계란말이, 또 생각나는 편의점 술안주 등 기억에 남는 것이 많다.

한 동안 달리던 시기를 지나 충분히 평화로웠던 시간이었다.

11월

CVPR

ICLR 제출을 마치고도 연구에 아쉬움이 많이 남았다.

큰 모델로의 스케일링 한계가 특히 그러했다.

나는 재현성과 모델의 성능은 다른 평가 축에 속한다 여기지만,

다른 연구원의 소감은 성능이 떨어지면 재현성이 어떤 의미를 갖는지였다.

만약 SOTA 모델의 예상 성능 범위 밖에

성능은 안 좋지만 재현성은 좋은 모델이 있다면 사람들이 쓸까 하는 것이었다.

ICLR 리뷰로도 당연히 올 수 있는 질문이라 생각했고,

9월부터 10월 스케일링을 위한 실험에 초점을 맞추었다.

SOTA 성능 범위 안에 우리 모델이 있다면 재현성의 가치가 높아지지 않을까 싶었다.

아무래도 논문이 이론적 논증과 실험적 실증 두 가지를 모두 집중하려다 보니,

성능상 개선 가능성이 높은 기술도 논증이 부족하면 선뜻 활용하지 못하고 있었다.

리뷰까지 남은 두 달, 후보 기술들의 이론적 논증도 마치고 실험도 다수 진행하였다.

실제로 성능이 크게 개선되었지만,

여전히 23-24년도 모델의 SOTA 성능 수준이었고 25년 SOTA 수준은 되지 못하였다.

이것저것 더 성능을 개선할 여지가 있는지 살피며 리뷰를 기다렸다.

리뷰가 공개되었다.

리뷰는 대개, 다른 데이터셋에서도 실험을 진행하여 보편성을 보일 수 있는가,

논증을 더 직관적인 설명할 수 있는가, 더 자세한 분석을 제공해 줄 수 있는가 등이었다.

성능상 한계에 관하여 짚은 리뷰도 있었고, 대체로 예상했던 선이었다.

가장 기억에 남는 것은 그래서 다른 연구들과 대비하여 어떤 차이점이 있는가였다.

결과적으로 너의 방법론이 이미 있던 연구를 조합한 것이 아닌가 물어왔다.

이때부터 연구의 포지션에 관하여 고민을 많이 하게 되었다.

Concurrent work라고 이야기할까 싶다가도,

관련 연구들을 언급하며 공통점과 차이점, 공유하고 있는 철학에 관하여 적었어야 했나

내가 내 연구의 차별점을 잘 표현하지 못하였나

왜 이런 세팅에서 실험하였고, 어디까지 커버할 수 있는가를 더 명확히 표현해야 했나 등

나는 내 맥락 내에서 연구의 전개에 관하여 자신도 있었으나,

이것이 독자에게 충분히 전달되지는 않은 것 같다는 생각도 들었다.

리뷰탈을 할까 싶다가도, 엎을 수 있는 점수처럼 느껴지지는 않았다.

논의 끝에 철회 후 추가 실험과 글을 수정하여 다음 학회에 내기로 하였다.

우선은 CVPR에도 제출하여 추가 리뷰를 받아보기로 하였다.

비록 이론보다는 실증과 개선에 초점을 맞춘 학회이지만,

더 다양한 시야에서 연구에 대한 이야기를 들어보고 싶어 제출을 제안하였다.

이번 버전에서는 리뷰를 가능한 많이 반영하고 싶었다.

데이터셋 추가 실험, 직관적 설명을 위한 이론과 실제 현상의 관계성,

설명을 도울 그림, 더 자세한 분석 등 본문과 별첨에 내용을 추가했다.

특히 Concurrent work와의 공통점과 차이점에 관한 파트를 자세히 적어보았다.

그 외에도 한 달간 개선된 버전의 모델로 방법론과 실험 파트를 업데이트하고,

학회 분위기에 맞게 이론보다는 실증적 문제 제기와 개선에 초점을 맞춰 수정했다.

큰 무리 없이 제출하였고, 조금은 마음 편히 리뷰를 기다려보려 한다.

12월 25.12.24.크리스마스

크리스마스

올해 크리스마스는 광화문에 다녀왔다.

등불 축제, 트리, 플리 마켓까지 을지로에서 광화문으로의 길이 한껏 꾸며져 있었다.

이곳저곳 구경 다니며 광화문 플리 마켓에도 다녀오려 했으나

대기 줄이 광화문 역사까지 이어진 것을 보고 플리 마켓은 포기하였다.

그 외에도 길거리 음식이나 볼거리, 행사 등 즐길거리가 많아 아쉽진 않았다.

다들 분위기도 좋고, 즐겁게 크리스마스를 지내는 듯보였다.

괜스레 설레는 마음으로 산책을 마치고

잠실에서 평소 먹고 싶던 케이크를 픽업해 와인과 함께 한 해를 마무리했다.

맥주

25년 맥주

올 한 해도 맥주 정말 많이 마셨다.

3년간 100캔 정도의 후기를 남겼다면, 올해에만 60캔 정도를 남긴 것 같다.

올해 기억에 남는 맥주는 설화이다.

어느 순간부터 편의점에 들어왔는데,

청량한 라거의 홉 향이 강한 탄산과 함께 넘어오는 게 상당히 깔끔하고 개운하다.

특히 끝 맛에 과실향이랑 단내가 나는 게 특이해서 기억에 남는다.

엑스파니아도 괜찮았는데,

라거처럼 치고 오는데 끝에 가면 포도주 오크향이 나는 게 상당히 특이하다.

25년 초에만 해도 크래프트 맥주가 이제 더 이상 주류가 아닌가 싶었다.

새로운 맥주는 거의 들어오지 않고 이젠 다른 취미를 가져야 하나 싶었다.

그러던 6월이 넘어가니 다시 새로운 맥주가 많이 들어왔다.

미국 맥주와 일본 맥주 풀이 늘어난 느낌이고,

그 중간에 크래프트 맥주나 독일-유럽권 맥주도 간간히 새로운 것이 보였다.

뭔가 그 기간에 새로운 이벤트가 있었나 싶기도 하다.

취미를 갈아탈 필요까지는 없겠지만,

건강을 위해 좀 줄여야 하나 싶기도 하다.

올해는 정말 일이 많은 한 해였다.

대학원이 예상에 부합했던 영역도 있지만,

예상과 달랐던 점도 많았던 것 같다.

이론 연구에 관하여도 생각이 많아진다.

회사에서는 하기 힘들어 대학원에서 해보고 싶었지만,

지금 보니 학계 사람이 업계 사람이고, 업계 사람이 학계 사람인가 싶기도 하다.

내가 한 일을 소개하고 표현하는 것도 어렵다.

회사는 내 담당자 혹은 상급자와 직접적 소통으로 해소할 수 있는 영역도

논문에서는 불특정 다수를 대하는 감각으로 대응해야 하는 것 같다.

하던 걸 더 잘해야 했던 시간에서

새로운 것이 계속 들어오는 시기가 되니 쉽지가 않다.